무료 로그 분석 도구 추천 5선, 서버 문제를 빠르게 잡는 실전 비교

서버 장애와 보안 위협을 미리 잡아내는 무료 로그 분석 도구를 기능별로 비교하고, 실전 도입 방법까지 정리했습니다

서버가 갑자기 느려지거나, 원인 모를 에러가 반복될 때 가장 먼저 확인해야 할 것이 로그입니다. 그런데 막상 수천 줄의 로그 파일을 열어보면 어디서부터 봐야 할지 막막하죠. 무료 로그 분석 도구를 활용하면 이 과정을 체계적으로 바꿀 수 있습니다.

로그 분석, 왜 반드시 해야 하는가

로그는 서버, 애플리케이션, 네트워크에서 발생하는 모든 이벤트의 기록입니다. 단순히 에러를 찾는 것을 넘어, 보안 위협 탐지와 성능 최적화의 핵심 데이터이기도 합니다.

- 장애 원인 추적 - 서버 다운타임의 78%는 로그에 사전 징후가 기록되어 있습니다. 미리 감지하면 장애를 예방할 수 있습니다.

- 보안 위협 탐지 - 비정상 로그인 시도, SQL 인젝션 패턴 등 공격 흔적이 로그에 남습니다.

- 성능 병목 파악 - 응답 시간이 느린 API, 메모리 누수가 발생하는 프로세스를 정확히 찾아낼 수 있습니다.

- 규정 준수 - 개인정보보호법, ISMS 인증 등에서 로그 보관과 분석은 필수 요건입니다.

문제는 수동 분석의 한계입니다. 하루 수십 GB씩 쌓이는 로그를 사람이 직접 읽는 것은 사실상 불가능합니다. 그래서 무료 로그 분석 도구의 도움이 필요합니다.

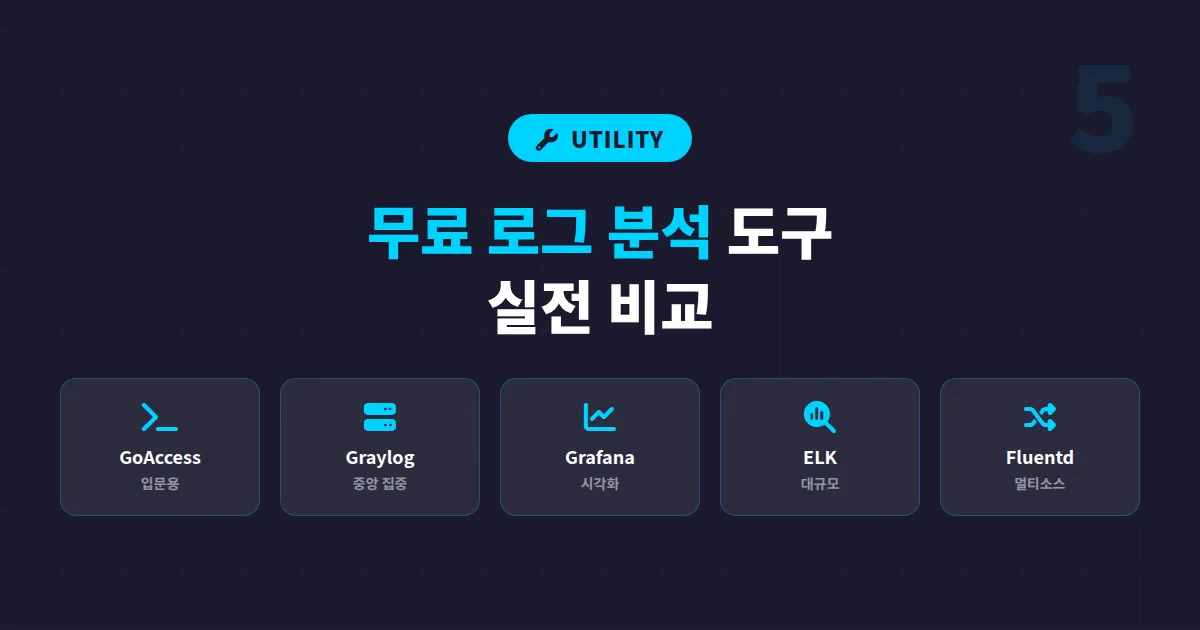

무료 로그 분석 도구 5가지 한눈에 비교

현재 사용 가능한 주요 무료 로그 분석 도구를 핵심 항목별로 정리했습니다.

| 도구명 | 라이선스 | 주요 용도 | 대시보드 | 알림 기능 | 난이도 |

|---|---|---|---|---|---|

| GoAccess | MIT | 웹 서버 로그 | 실시간 HTML | 없음 | 쉬움 |

| Graylog Open | SSPL | 중앙 집중 로그 | 커스텀 가능 | 이메일, Slack | 중간 |

| Grafana + Loki | AGPLv3 | 로그 + 메트릭 통합 | 고급 시각화 | 다양한 채널 | 중상 |

| ELK Stack | Elastic License | 대규모 로그 | Kibana 내장 | Watcher 플러그인 | 어려움 |

| Fluentd + Kibana | Apache 2.0 | 멀티소스 수집 | Kibana 연동 | 플러그인 | 중간 |

소규모 서비스라면 GoAccess로 시작하고, 서버가 3대 이상이면 Graylog나 Grafana + Loki 조합을 검토하세요. 도구를 고를 때 가장 중요한 기준은 현재 인프라 규모와 팀의 운영 역량입니다.

도구별 상세 기능과 장단점

GoAccess - 가장 빠르게 시작할 수 있는 도구

터미널에서 바로 실행되는 실시간 웹 로그 분석기입니다. Apache, Nginx, Amazon S3 등 주요 웹 서버 로그 형식을 자동으로 인식합니다. 설치 후 한 줄 명령어로 바로 분석 결과를 확인할 수 있어서 입문용으로 적합합니다.

- 장점: 설치가 간단하고, 서버 리소스를 거의 사용하지 않습니다. HTML 리포트를 자동 생성합니다.

- 단점: 웹 서버 로그에 특화되어 있어 애플리케이션 로그 분석에는 한계가 있습니다.

Graylog Open - 중소 규모 팀의 실전 선택

중앙 집중형 로그 관리 플랫폼입니다. 여러 서버의 로그를 한 곳에서 수집하고, 검색과 필터링이 직관적입니다. Syslog, GELF, JSON 등 다양한 입력 형식을 지원하며, 스트림 기반 분류로 로그를 체계적으로 관리할 수 있습니다.

Grafana + Loki - 시각화 중심 분석

Grafana의 강력한 대시보드와 Loki의 가벼운 로그 저장 엔진을 결합한 구성입니다. 메트릭 모니터링과 로그 분석을 한 화면에서 처리할 수 있다는 점이 가장 큰 장점입니다. Prometheus를 이미 쓰고 있다면 자연스러운 확장입니다.

ELK Stack - 대규모 환경의 표준

Elasticsearch, Logstash, Kibana의 조합으로, 대량의 로그 데이터를 빠르게 검색하고 분석합니다. 하루 수십 GB 이상의 로그를 처리해야 하는 환경에 적합하지만, 초기 세팅에 시간이 필요하고 메모리 요구량이 높습니다.

로그 분석 시작하기 실전 세팅

무료 로그 분석 도구 중 가장 진입장벽이 낮은 GoAccess를 기준으로 실전 세팅 과정을 정리합니다.

1단계: 설치

Ubuntu 기준으로 패키지 매니저를 통해 설치합니다. apt install goaccess 한 줄이면 끝납니다. CentOS에서는 yum이나 dnf를 사용하면 됩니다.

2단계: 기본 분석 실행

Nginx 로그를 분석하려면 goaccess /var/log/nginx/access.log --log-format=COMBINED 명령을 실행합니다. 터미널에 실시간 대시보드가 바로 표시됩니다.

3단계: HTML 리포트 자동 생성

크론탭에 리포트 생성 명령을 등록하면, 매일 자동으로 분석 결과 HTML 파일이 만들어집니다. 이 파일을 웹 서버의 특정 경로에 두면 브라우저에서 바로 확인할 수 있습니다.

- 방문자 수, 요청 경로, 응답 코드별 통계를 한눈에 파악할 수 있습니다.

- 404 에러가 집중되는 URL을 찾아 리다이렉트를 설정하면 SEO에도 도움이 됩니다.

- 특정 IP에서 비정상적으로 많은 요청이 들어오는지 확인하여 보안 위협을 조기에 차단할 수 있습니다.

개발이나 운영 업무 중 로그 데이터 외에 다른 형식의 데이터를 빠르게 변환해야 할 때도 있습니다. 예를 들어 API 응답값을 디버깅할 때 Base64 인코더를 활용하면 인코딩된 문자열을 즉시 디코딩하여 원본 데이터를 확인할 수 있어 로그 분석과 함께 유용합니다.

로그 분석 효율을 높이는 운영 팁

도구를 설치하는 것만으로는 부족합니다. 실제 운영에서 효과를 보려면 몇 가지 습관이 필요합니다.

로그 포맷 표준화

서비스마다 로그 형식이 다르면 분석이 어려워집니다. JSON 형식으로 통일하면 파싱이 간편해지고, 필드 기반 검색이 가능해집니다.

로그 레벨 구분 활용

DEBUG, INFO, WARN, ERROR, FATAL 등 로그 레벨을 명확히 구분하여 기록하세요. 알림 설정 시 ERROR 이상만 필터링하면 불필요한 알림 피로를 줄일 수 있습니다.

보관 주기 설정

로그는 무한히 쌓아두면 디스크를 잡아먹습니다. 일반적으로 실시간 분석용은 7일, 감사 추적용은 90일, 법적 보관 의무가 있는 로그는 관련 법규에 따라 보관 기간을 설정하세요.

서버 로그 외에도 업무 중 단위 환산이나 데이터 변환이 필요한 순간이 자주 찾아옵니다. 단위 변환기 같은 온라인 도구를 즐겨찾기에 추가해 두면 사소한 작업에 시간을 뺏기지 않을 수 있습니다.

무료 로그 분석 도구는 이미 충분히 강력합니다. 중요한 것은 어떤 도구를 선택하느냐보다, 지금 바로 시작하느냐입니다. 오늘 GoAccess 하나만 설치해서 지난 7일간의 접속 로그를 분석해 보세요. 그동안 몰랐던 트래픽 패턴과 잠재적 문제점이 보이기 시작할 것입니다.